Last year’s objective: Our goal is to have 1,000 new, well-sourced biographies of women created and 40 new editors during the initiative; share of women’s biographies from ~19.5 % to over 20 %.

This year’s objective: Make bias visible and focus on closing the gaps in participation and content by organizing 3-5 events, with 1000 new articles of well sourced biographies of women/minorities.

- Hosting writing events for closing gender gap (Womens month events, Women in Red)

- Support third parties when they are organizing events,

- Co-operate with Finnish Wikipedia’s Weekly competitions and other competitions

- Improve the ability to participate in Finnish Wikipedia’s competitions with minority languages in Finland

So far this year, we have had two major online events that address the gender gap on the Finnish, Inari Saami, Northern Saami, and Livvi-Karelian Wikipedias. The Skolt Saami incubator project has also been included in these events, although the gender gap there is actually the reverse of what it is everywhere else: all of its biographies are about women.

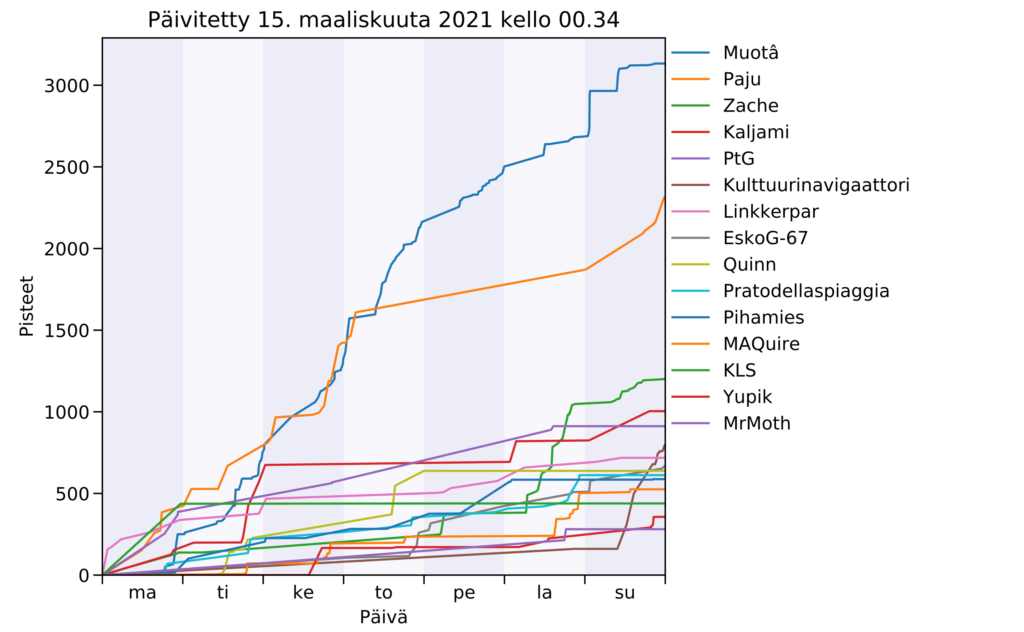

The first event (Viikon_kilpailu_2021-10) was held in conjunction with the Weekly Competition in the Finnish Wikipedia, which started on International Women’s Day. Like last year, the week-long competition gave editors points for writing biographies about people whose gender value is not male in Wikidata.

For the first event, 23 of the 25 editors who registered for the weekly competition went on to edit articles. These 23 editors created 83 articles, improved those 83 and another 224 articles, added 207 new images, and added 592 references to sources in Finnish, Inari Saami, and Northern Saami. Out of all of the 307 articles that were created or edited during the competition, a whopping 45 of these were in Inari Saami, a language of approximately 400 speakers whose Wikipedia had been launched in October 2020, only a few months before the competition. Many of these articles were written about the CASLE language masters , who are one of the major reasons Inari Saami is thriving.

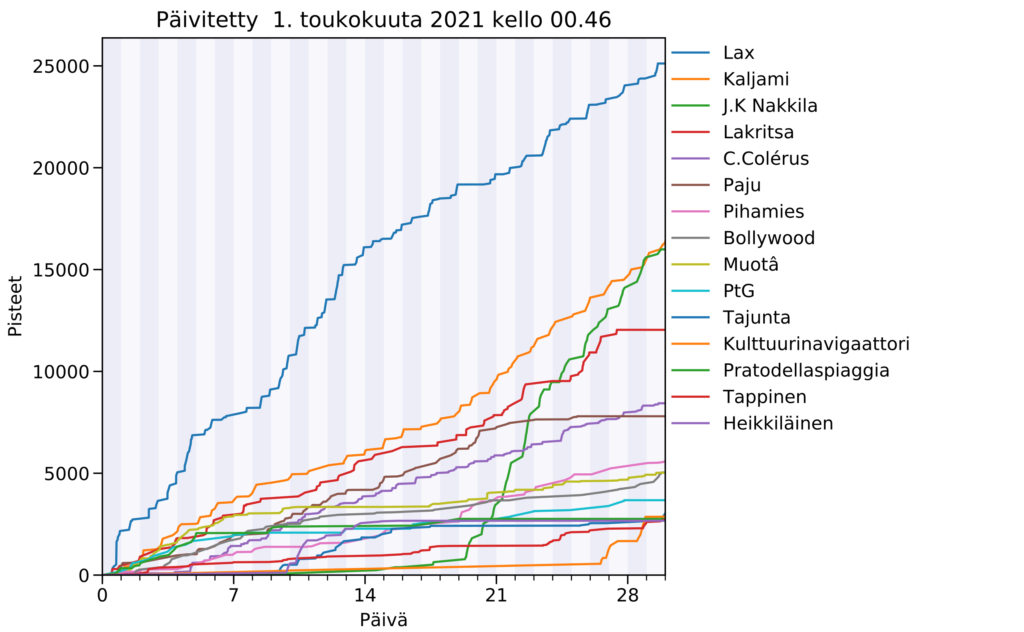

The second event (Wikiprojekti:Punaisten_linkkien_naiset_2021) started off with a bang as the Finnish Wikipedia rushed past the magic 20% marker for biographies about women already on the first day of the competition. This month-long Women in Red edit-a-thon saw 154 editors sign up for the competition, of whom 108 ended up participating in Finnish, Inari Saami, Northern Saami, and Skolt Saami. If we compare this year’s competition to the previous two years combined, this year was a smashing success. In the 2019 and 2020 competitions combined, editors created a total of 1540 articles, added a total of 1043 images, and added a total of 6643 sources. In 2021 alone, editors added more images and sources than in both 2019 and 2020 combined and just barely missed doing the same for creating new articles.

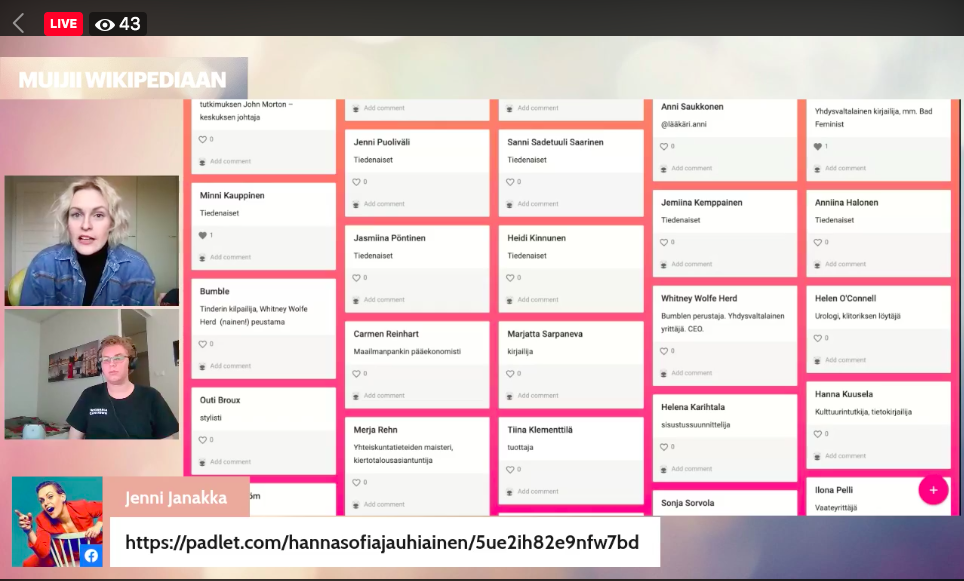

Part of this success is indubitably due to partnering with author and speech artist Jenni Janakka, whom we first worked with back in 2019 during that year’s Women in Red competition. Together we organized a virtual mini-editathon on Facebook , where a representative of Wikimedia Finland and Janakka showed viewers how to edit Wikipedia and encouraged them to follow along by editing at the same time. This was followed by a second mini-editathon for social media influencers. Janakka always brings with her a list of suggested topics that the stereotypical Wikipedia editor would not necessarily think about adding to Wikipedia, if they even knew they existed in the first place. This results in a much more diverse range of topics than we normally see in these types of competitions.

By the end of the competition, the gender gap in the Finnish Wikipedia peaked at 20.53%, Inari Saami at 52.68%, and the biographies on the Skolt Saami incubator continued to be 100% about women. There were no changes in the figures for the Northern Saami or Livvi-Karelian Wikipedias during the competition.